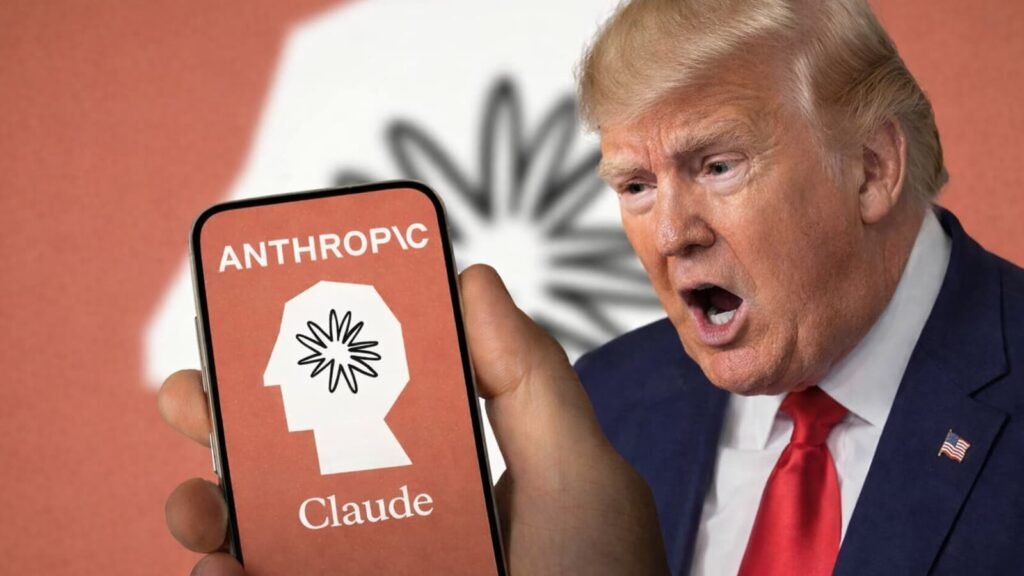

A Anthropic anunciou que entrou com uma ação judicial contra a administração Trump, após ter sido classificada pelo Pentágono como um “risco de cadeia de suprimentos”. A empresa alega que a decisão constitui retaliação por ter se recusado a remover mecanismos de segurança — conhecidos como “corrimões de proteção” — de seu modelo de inteligência artificial Claude, projetado para uso seguro e ético.

Líderes da indústria, incluindo OpenAI e Google, manifestaram apoio ao Anthropic, destacando que a ação do Pentágono poderia resultar em perdas bilionárias em contratos e representar uma violação da Primeira Emenda, que protege a liberdade de expressão nos Estados Unidos.

Especialistas do setor alertam que o caso pode criar um precedente perigoso para empresas de IA, com implicações significativas sobre inovação ética, desenvolvimento de tecnologias seguras e regulamentação governamental. Há receio de que futuras decisões semelhantes possam sufocar iniciativas de pesquisa responsável em inteligência artificial.

O mercado financeiro e tecnológico ainda não refletiu plenamente o impacto potencial dessa disputa legal, mas analistas destacam que a indústria observa atentamente, dado que o resultado pode redefinir normas de conformidade e governança para desenvolvedores de IA nos Estados Unidos e globalmente.

O desfecho do processo pode ter repercussões duradouras, influenciando políticas de segurança, relações com órgãos governamentais e a competitividade de empresas de tecnologia emergentes em um setor marcado por rápida inovação e alta sensibilidade regulatória.

Pimco Corporate & Income Opport PTY

Pimco Corporate & Income Opport PTY Aneka Tambang Tbk. ANTM.JK

Aneka Tambang Tbk. ANTM.JK Timah Tbk. TINS.JK

Timah Tbk. TINS.JK S&P/TSX Composite index ^GSPTSE

S&P/TSX Composite index ^GSPTSE Loews Corporation L

Loews Corporation L Defiance Daily Target 2x Long R RCAX

Defiance Daily Target 2x Long R RCAX Brent Crude Oil Last Day Financ BZ=F

Brent Crude Oil Last Day Financ BZ=F Leverage Shares 2x Long DNN Dai DNNG

Leverage Shares 2x Long DNN Dai DNNG NASDAQ Composite ^IXIC

NASDAQ Composite ^IXIC Natural Gas Jul 26 NG=F

Natural Gas Jul 26 NG=F Brazilian Real Futures,Jul-2026 6L=F

Brazilian Real Futures,Jul-2026 6L=F MICROSOFT CORP. R MSF.HA

MICROSOFT CORP. R MSF.HA Vanguard Total World Stock Inde VT

Vanguard Total World Stock Inde VT Boditech 206640.KQ

Boditech 206640.KQ SamsungElec 005930.KS

SamsungElec 005930.KS Boston Beer Company, Inc. (The) SAM

Boston Beer Company, Inc. (The) SAM Hotchkis & Wiley Value Opportun HWAAX

Hotchkis & Wiley Value Opportun HWAAX